Artificial Intelligence ist nicht "künstliche Intelligenz" sondern "künstliche Datenverarbeitung".

GPT heißt Generative Pre-trained Transformer. Was bedeutet das? Das Modell wird auf große Mengen von Daten losgelassen, um eigenständig Muster zu erkennen. Das ist die Lernphase. Die Daten, im vorliegenden Fall eines LLMs (Large Language Model) handelt es sich dabei um Text, werden im Fall eines Transformers zu maschinell interpretierbaren Tokens umgewandelt. Als generatives Modell wird dieser vorbereitete Transformer eingesetzt, um bei Eintreffen einer Aufforderung (deines Prompts) diese Aufforderung zu Tokens umzuwandeln, diese mit dem Transformer interagieren zu lassen, sodass die Tokens ausgerechnet werden, die als Reaktion auf die eingegebenen Tokens am wahrscheinlichsten sind. Dieses Rechenergebnis wird dann in natürliche Sprache gewandelt und das erhältst du als Output.

Was fehlt auffallend in dieser Beschreibung?

- Bewusstsein. Wir haben es hier einfach nur mit einer Maschine zu tun, die mathematische Operationen durchführt.

- Sprachverständnis. Die Maschine versteht kein Wort. Sie berechnet nur im ihr vorgegebenen Rahmen Dinge.

- Wissen, Logik, Kompetenz. Es ist eine textsprachliche Wahrscheinlichkeitsrechnung. Dahinter steht niemand, der wirklich weiß, was er sagt, das Ergebnis kann erfunden, faktisch falsch oder schliecht unlogisch sein.

- Aufgabenbewältigung. Ein LLM wie ChatGPT ist zunächst mal nur dazu gebaut, Text zu verarbeiten und Text auszugeben.

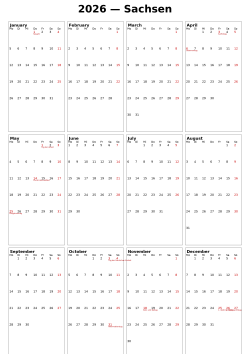

Wenn du deine Aufforderung an den Server sendest, berechnet also einfach nur eine Maschine aufgrund eines Trainings, was die wahrscheinlichste Antwort ist. Das kann völlig daneben liegen und insbesondere etwas sein, das du nicht haben möchtest. Im vorliegenden Fall hast du eine sehr komplexe Aufforderung geschickt. Dein Textbot muss nämlich zunächst mal erkennen, dass du ein ganz anderes Modell ansteuern willst, nämlich ein generatives Bildmodell. Dann muss erkannt und korrekt umgesetzt werden, effektive Aufforderungen an dieses Bildmodell zu schicken. Dann muss dieses Bildmodell aufgrund seiner eigenen Wahrscheinlichkeitsrechnung den wahrscheinlichsten Output für diese Aufforderungen errechnen. Bei bloßen Bildern mag das fast klappen, aber da du auch noch Text im Bild haben willst, wird es ganz kompliziert, denn dafür sind wiederum generative Bildmodelle nicht gebaut. Und das mit Bonusspezifikation zum Dateiformat und Inhalt und den Maßen (die du mit einer analogen, physischen Norm angegeben hast, obwohl du einen digitalen Output haben möchtest, wobei du keine Angabe zu den Bildpunkten mitgegeben hast, die für die Umrechnung von DINA3 zu einem digitalen Bildformat nötig wären – du machst es der Maschine nicht leicht). Nur versteht ChatGPT nicht, was ein Dateiformat ist, weil es nur Tokenwahrscheinlichkeiten berechnet, ebensowenig was deutsche Feiertage sind. Dazu müsste im Hintergrund eine Web-Recherche dazugeschaltet werden, die tokenisiert verarbeitet wird. Der Bildgenerator wiederum kann mit einer Erklärung, was Text ist, nichts anfangen, weil er darauf nicht traniert ist.

Du kriegst also mit etwas Glück ein Bild zurück und das wird höchstwahrscheinlich nicht sein, was du haben wolltest.

Künstliche Dummheit würde ich das nicht nennen, sondern ein Fehlverständnis des Anwenders, was Wirkweise, Möglichkeiten und Grenzen generativer AI sind.

Analog gesprochen: Graue Gentechnik ist eine tolle Sache und die so geformten Organismen sind extrem praktische, jeweils für ihre Spezialisierung unersetzliche Arbeitstiere. Nur soll man sich nicht wundern, wenn ein Bakterium, das zu einer bestimmten Esterisierung geformt ist, einem nicht bei der Steuererklärung helfen kann. Dafür ist es einfach nicht geeignet.

Oder: Ich kann einen noch so tollen Zimmermannshammer haben, dadurch wird die Katze im Nachbarsort immer noch kein guter Opernsänger.

Das klingt alles völlig absurd? Weil die Kategorien von Anforderung und Möglichkeit völlig aneinander vorbeigehen. Und das ist bei deiner Aufforderung an ChatGPT eben ähnlich.

Kennst du das Gedankenexperiment vom Chinesischen Zimmer? Darin geht es ziemlich genau um solche Sachverhalte. Sollte man sich mal mit auseinandersetzen, ist sehr anregend.